C'est pas un scoop, mais sachez tout de même que Sqoop est un projet de la fondation Apache.

Je sais c'est une blague facile...

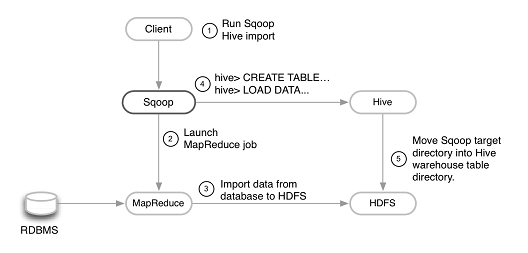

Passons et intéressons-nous plutôt à cet outil permettant une cohabitation des bases de données (Oracle, mysql…) avec la plateforme Hadoop (Le nom Sqoop est un mot valise constitué de sql et de hadoop)

Ainsi, Sqoop (interface en ligne de commande) permet d’exporter des données depuis la base de données et de procéder aux traitements en exploitant le cluster Hadoop.

En gros, Sqoop prend des données à la source et les écrit dans une destination. On ne peux pas faire plus simple !

Passons et intéressons-nous plutôt à cet outil permettant une cohabitation des bases de données (Oracle, mysql…) avec la plateforme Hadoop (Le nom Sqoop est un mot valise constitué de sql et de hadoop)

Ainsi, Sqoop (interface en ligne de commande) permet d’exporter des données depuis la base de données et de procéder aux traitements en exploitant le cluster Hadoop.

En gros, Sqoop prend des données à la source et les écrit dans une destination. On ne peux pas faire plus simple !

A noter également que Sqoop embarque les connecteurs JDBC pour permettre la connexion à la base distante.

Je ne vais pas vous présenter toutes les options ou subtilités de l'outil, mais simplement vous présenter un cas simple d'utilisation. Si vous souhaitez approfondir l'utilisation de Sqoop , la documentation est bien faite et les exemples nombreux sur internet.

A noter également que Sqoop embarque les connecteurs JDBC pour permettre la connexion à la base distante.

Je ne vais pas vous présenter toutes les options ou subtilités de l'outil, mais simplement vous présenter un cas simple d'utilisation. Si vous souhaitez approfondir l'utilisation de Sqoop , la documentation est bien faite et les exemples nombreux sur internet.

Passons et intéressons-nous plutôt à cet outil permettant une cohabitation des bases de données (Oracle, mysql…) avec la plateforme Hadoop (Le nom Sqoop est un mot valise constitué de sql et de hadoop)

Ainsi, Sqoop (interface en ligne de commande) permet d’exporter des données depuis la base de données et de procéder aux traitements en exploitant le cluster Hadoop.

En gros, Sqoop prend des données à la source et les écrit dans une destination. On ne peux pas faire plus simple !

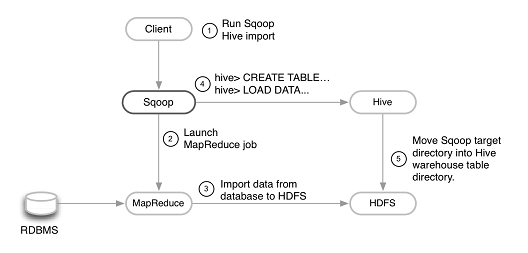

Passons et intéressons-nous plutôt à cet outil permettant une cohabitation des bases de données (Oracle, mysql…) avec la plateforme Hadoop (Le nom Sqoop est un mot valise constitué de sql et de hadoop)

Ainsi, Sqoop (interface en ligne de commande) permet d’exporter des données depuis la base de données et de procéder aux traitements en exploitant le cluster Hadoop.

En gros, Sqoop prend des données à la source et les écrit dans une destination. On ne peux pas faire plus simple !

A noter également que Sqoop embarque les connecteurs JDBC pour permettre la connexion à la base distante.

Je ne vais pas vous présenter toutes les options ou subtilités de l'outil, mais simplement vous présenter un cas simple d'utilisation. Si vous souhaitez approfondir l'utilisation de Sqoop , la documentation est bien faite et les exemples nombreux sur internet.

A noter également que Sqoop embarque les connecteurs JDBC pour permettre la connexion à la base distante.

Je ne vais pas vous présenter toutes les options ou subtilités de l'outil, mais simplement vous présenter un cas simple d'utilisation. Si vous souhaitez approfondir l'utilisation de Sqoop , la documentation est bien faite et les exemples nombreux sur internet.